Telegram爬虫:数据采集的机遇与挑战

在当今信息爆炸的时代,Telegram作为一款全球流行的即时通讯应用,不仅承载着海量的个人对话,更孕育了无数公开频道、群组和机器人,形成了一个巨大的信息宝库。Telegram爬虫,即针对该平台的数据采集技术,应运而生,成为研究人员、市场分析师和开发者挖掘这一宝库的关键工具。它通过自动化程序模拟用户行为,访问公开可得的频道与群组消息,实现大规模、高效率的信息收集与整理。

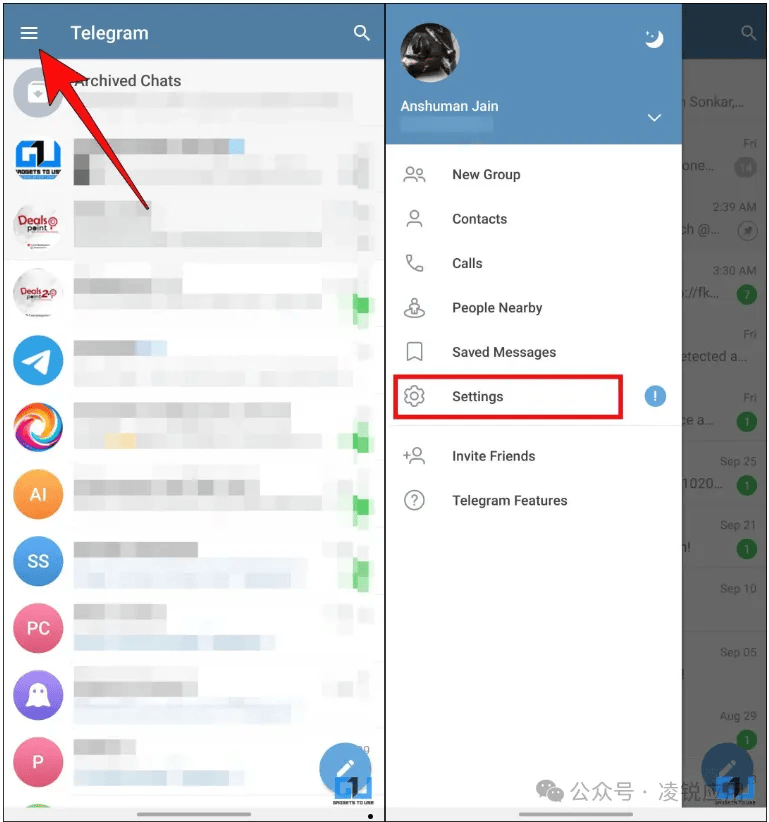

从技术层面看,Telegram爬虫的实现主要依赖于其官方提供的Bot API和更底层的MTProto协议。Bot API为开发者提供了相对便捷的接入方式,允许机器人获取其所在群组或频道的信息,功能稳定但受限于官方设定的权限规则。而对于更广泛或更深入的数据采集需求,开发者有时会转向MTProto协议,通过创建自定义客户端进行直接通信,这种方式灵活性更高,但技术复杂度与维护成本也显著增加。无论采用哪种方式,爬虫的核心任务都是解析Telegram的数据结构,如消息、媒体、用户元数据等,并将其转化为结构化数据以供后续分析。

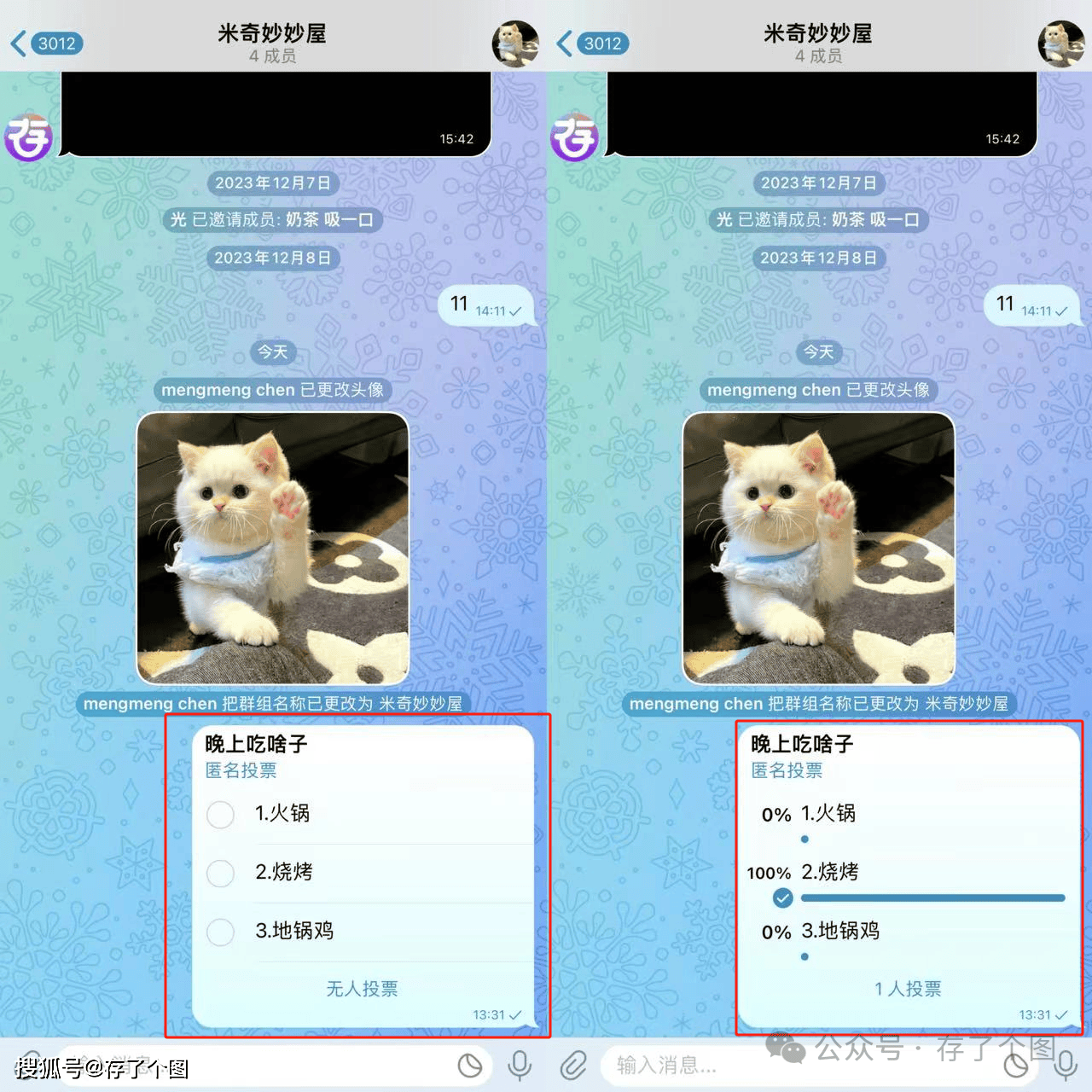

Telegram爬虫的应用场景极为广泛。在学术研究领域,社会科学家可以分析特定话题在大型公开群组中的传播模式;在市场情报方面,企业能够监测品牌提及、竞品动态或行业趋势;在新闻媒体行业,记者可以追踪突发事件的第一手现场信息。此外,开发者也能利用爬虫为频道创建搜索引擎、内容聚合器或数据分析仪表盘,极大地提升了信息的可及性与价值。

然而,构建和运行Telegram爬虫并非毫无挑战。首要的挑战便是法律与伦理的边界。Telegram的服务条款明确禁止未经授权的大规模数据抓取行为,尤其是侵犯用户隐私的活动。爬虫操作必须严格限定于完全公开的频道和群组信息,绝对避开私人聊天,并尊重版权与数据保护法规,如GDPR。其次,技术挑战也不容小觑。Telegram会采取反自动化措施,频繁或异常的请求可能导致IP地址被封禁。因此,一个稳健的爬虫需要设计合理的请求频率、使用代理IP池并处理各种网络异常。

展望未来,随着Telegram生态的持续扩张,对其公开信息进行合规、有效挖掘的需求只会增不减。成功的Telegram爬虫项目,必然是技术能力与法律伦理意识的结合体。开发者和使用者必须时刻铭记,技术是工具,其应用应当以负责任为前提,在探索数据价值的同时,坚决维护用户隐私与平台生态的健康,方能在数据采集的道路上行稳致远。