当自由之声被静默:Telegram机器人禁言机制详解

在数字时代的广场上,Telegram以其强大的隐私保护和灵活的群组功能,成为了全球数亿用户交流的重要平台。然而,在这个看似自由的虚拟空间里,一种名为“机器人禁言”的机制,正悄然塑造着社区互动的边界。这不仅是技术工具的应用,更涉及权力、秩序与言论自由的复杂博弈。

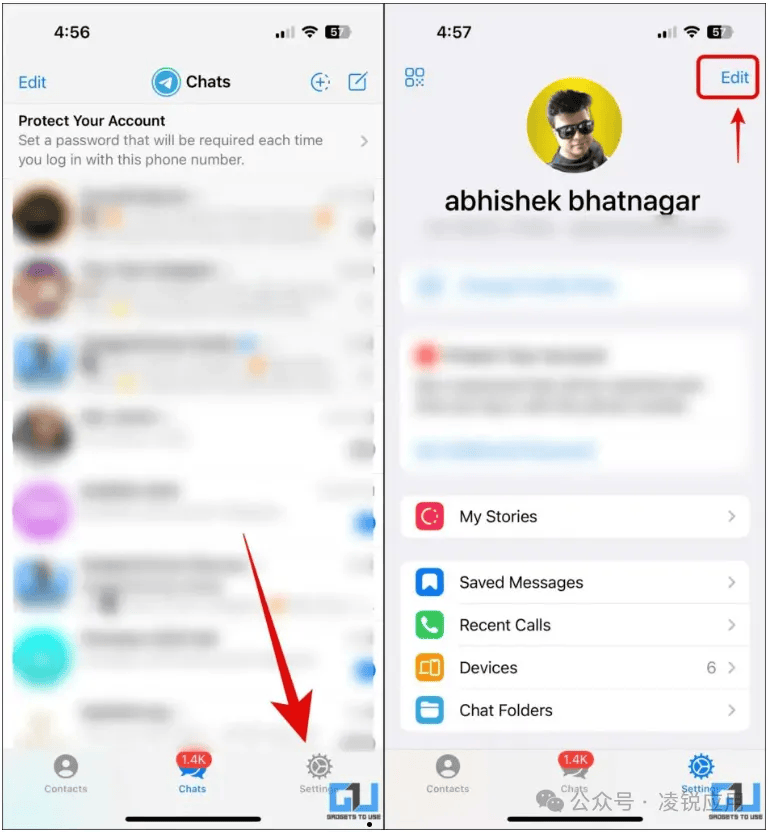

Telegram机器人的禁言功能,本质上是群组管理员委托给自动化程序的权限延伸。通过配置特定的机器人(如著名的@GroupHelpBot或@AdminBot),管理员可以设定规则,让机器人自动监控并处理违规行为。常见的触发条件包括:发送垃圾广告链接、刷屏式重复信息、发布恶意软件或使用不当语言。一旦触发规则,机器人可在无需人工干预的情况下,对用户实施从短暂禁言到永久踢出群组的处罚。

从技术层面看,这一机制展现了Telegram开放API的巧妙运用。开发者能够创建具有不同复杂度的机器人,从简单的关键词过滤到基于机器学习的内容识别。例如,某些高级机器人可以分析消息模式,识别出协同操作的垃圾账号网络,并进行批量处置。这种自动化管理在大型公开群组中尤为重要——当成员数量达到数万甚至数十万时,纯粹的人工审核几乎不可能实现。

然而,自动化禁言始终伴随着争议。最核心的矛盾在于:算法如何准确理解人类语言的微妙语境?一个讨论政治讽刺的群组和一个家庭教育群组,对“不当内容”的定义可能天差地别。机器人可能错误地将学术讨论中的敏感词汇判定为违规,或将反讽表达误读为真实攻击。这种“误杀”现象,常使用户感到挫败,认为自己的表达权被机械规则所扼杀。

更值得深思的是权力结构的变化。当禁言权力被编码进机器人程序时,规则的制定权实际上从社区集体协商,转移到了机器人开发者和管理员手中。虽然Telegram允许申诉机制,但在许多情况下,被禁言用户往往面临无处申辩的困境。这种“黑箱操作”的可能性,使得机器人禁言功能可能被滥用为排除异见、压制讨论的工具,尤其在政治敏感或商业竞争相关的群组中。

面对这些挑战,平衡之道或许在于透明度和制衡机制的设计。一些进步性的实践正在涌现:例如公开机器人的过滤规则库、设置多层级的人工复核流程、建立独立的仲裁委员会等。Telegram官方也在持续优化平台工具,如提供更精细的权限控制选项,让管理员可以设定机器人仅对新人或低信任度账号执行自动禁言,而对老成员采取人工审核。

最终,Telegram机器人禁言现象折射出一个更宏大的数字社会命题:我们如何在享受技术带来的管理效率时,守护开放对话的初心?每个社区都需要在秩序与自由、效率与公平之间找到自己的平衡点。而作为用户,了解这些机制背后的逻辑,既是为了保护自身权益,也是在参与塑造数字公共空间的未来形态——毕竟,在虚拟世界的广场上,谁有权静默他人,从来都不应该是个无需讨论的问题。