# 关于Telegram平台内容管理的讨论

## 引言:数字时代的平台责任

在当今数字时代,社交媒体平台如Telegram在全球范围内拥有数亿用户,成为信息传播的重要渠道。这些平台在促进交流的同时,也面临着如何管理有害内容的重大挑战。平台内容审核机制的设计与实施,直接关系到网络环境的健康与安全。

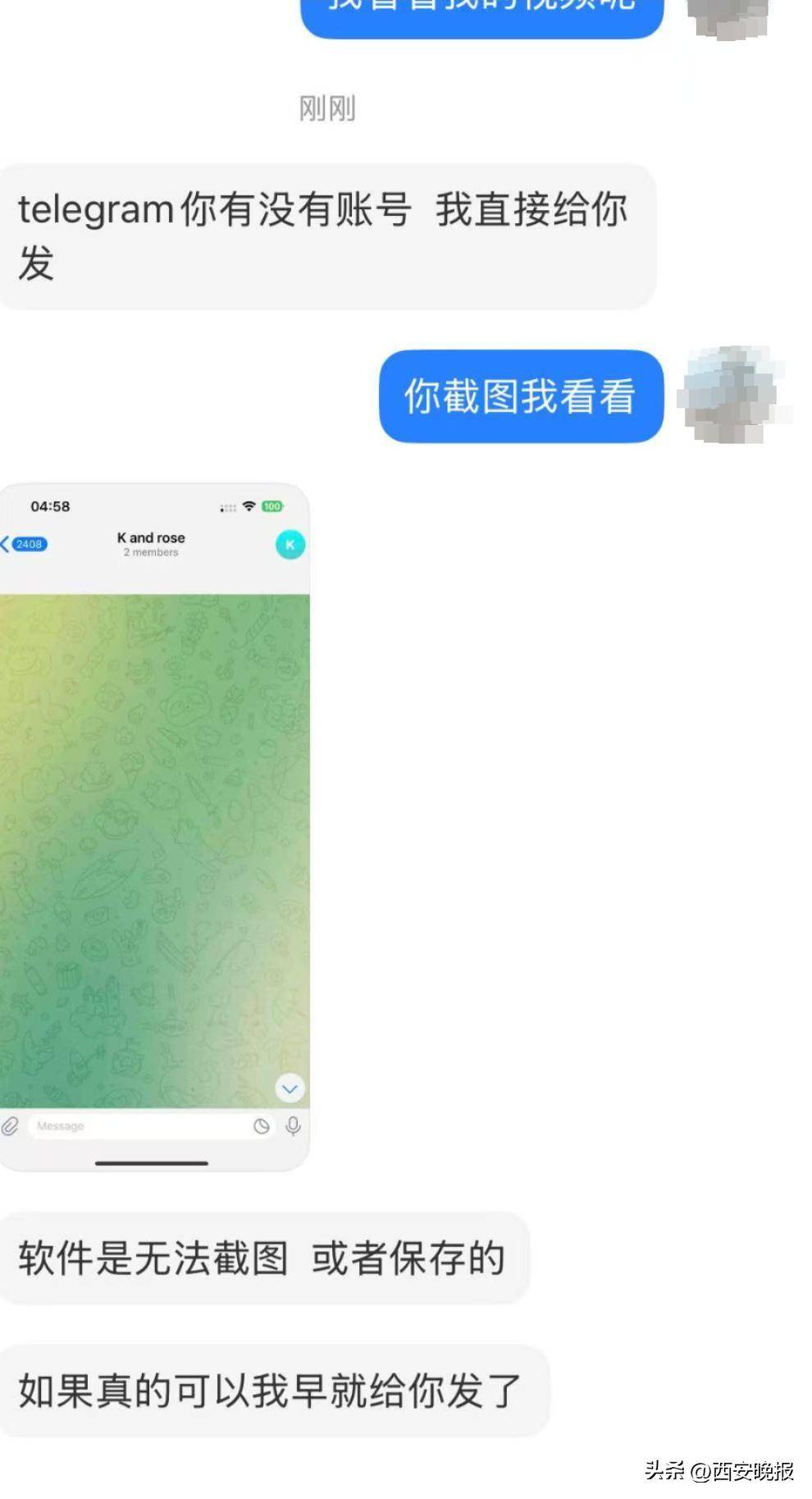

## 内容审核的复杂性

Telegram作为注重隐私保护的即时通讯应用,其内容管理政策一直备受关注。所有负责任的社交媒体平台都需要在言论自由与内容安全之间寻找平衡点,建立透明、一致的内容审核标准。这涉及到技术手段、人工审核和法律合规等多方面因素,是一个持续演进的复杂过程。

## 全球监管环境的变化

近年来,各国政府对网络平台内容监管提出了更高要求。欧盟的《数字服务法案》、德国的《网络执行法》等立法举措,都反映了国际社会对平台责任认识的深化。这些法规要求平台建立更有效的内容审核机制,及时处理违法信息,同时保障用户的合法权益。

## 技术解决方案与人工审核的结合

现代平台通常采用人工智能技术与人工审核相结合的方式管理内容。机器学习算法可以初步筛选可疑内容,再由专业审核团队进行最终判断。这种模式既提高了效率,又避免了完全依赖算法可能产生的误判问题。然而,这种系统仍需不断完善,以应对不断变化的内容挑战。

## 用户教育与社区自律

除了平台方的管理措施,用户教育和社区自律同样重要。提高用户的数字素养,帮助他们识别虚假和有害信息,是构建健康网络环境的基础。许多平台正在加强用户举报机制和社区准则宣传,鼓励用户参与内容治理。

## 结语:共建安全的数字空间

社交媒体平台的内容管理是一个需要多方协作的系统工程。平台运营商、政府部门、民间组织和用户都需要承担相应责任,通过对话与合作,共同营造一个既开放又安全的数字交流环境。这需要持续的技术创新、政策完善和社会对话,是数字时代我们必须面对的重要课题。